Iedereen weet dat heden ten dage audioapparatuur geheel gebaseerd is op elektronica en dat daarbij allerlei ‘actieve’ componenten worden gebruikt zoals triodes, penthodes, diodes, transistoren, FET’s, IC’s etc. Maar de vraag is uiteraard waarom, want geluid is een puur mechanisch verschijnsel: het trillen van lucht.

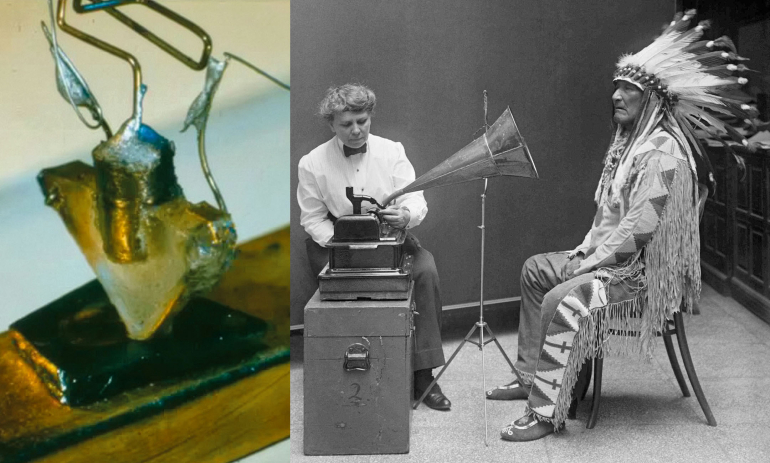

Figuur 6 (links): De eerste transistor uit Bell labs, die eigenlijk min of meer bij toeval is ontdekt. Men was op zoek naar, wat wij nu een veld-effect transistor (FET) noemen. Maar bij het experimenteren met dubbel-diodes werd de bipolaire transistor gevonden. Figuur 2 (rechts): Het opnemen van de spraak van een ‘native’ om hun taal vast te leggen. © Library of Congress | Publiek domein

Niet voor niets zijn de meeste instrumenten, die al langer worden gebruikt, zuiver mechanisch van aard, zoals violen, trompetten cymbalen, etc. Maar in de loop van de tijd is mechanica door de ontwikkelingen ook gebruikt in combinatie met elektronica (zoals de elektrische gitaar) en er zijn volledig elektronische instrumenten ontwikkeld, zoals de synthesizer. Maar de vraag blijft waarom we eerst de luchttrillingen in elektrische trillingen omzetten om die uiteindelijk weer in luchttrillingen terug te toveren want onze oren kunnen nog steeds uitsluitend geluid verwerken. Ook brengt iedere conversie problemen en verlies van kwaliteit met zich mee. Maar we doen dit omdat er onmiskenbaar veel voordelen aan verbonden zijn, maar welke dan? Om dat te begrijpen moeten we eerst een beetje in de geschiedenis van audio duiken.

Vastleggen & opslaan

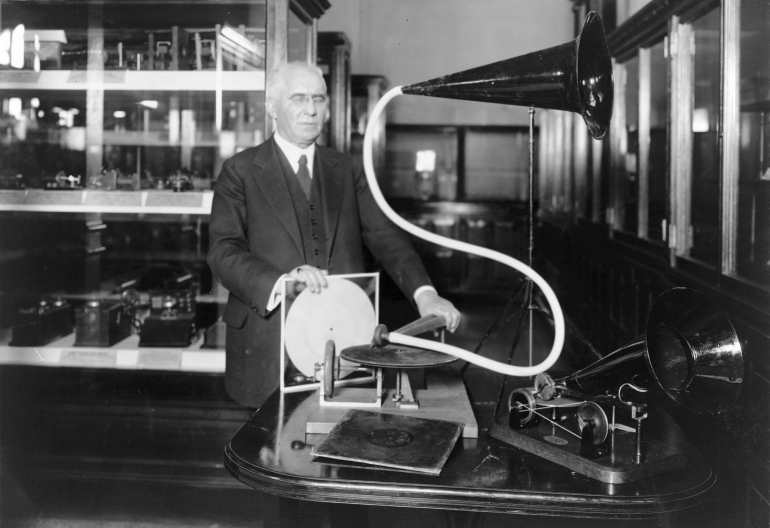

Een basisprobleem bij audio is het vastleggen en opslaan om geluid te kunnen reproduceren. De eerste oplossing hiervoor is in 1877 bedacht door Edison met de Phonograph, te zien in figuur 1.

Het geluid dat vastgelegd moest worden bracht een membraan in trilling en dit werd door een naald overgebracht op een folie van tin of een wasrol. Bij het afspelen werd het omgekeerde proces gevolgd: de wasrol bracht een naald in trilling en deze weer een membraan. Door de zeer efficiënte koppeling naar de lucht middels een hoorn werd het geluid weer hoorbaar gemaakt.

Het op te nemen geluid moest direct naar de wasrol worden geleid, wat niet altijd eenvoudig was, zeker niet als een orkestje of band moest worden opgenomen. Gelukkig zijn er een aantal illustratieve foto’s bewaard gebleven, zoals bijvoorbeeld te zien is in figuur 2.

Hoewel dit op zich wel werkte, waren de mogelijkheden sterk beperkt, zeker wat betreft de bewerking en vermenigvuldiging van de opnamen, maar dat laatste onderging een metamorfose. Berliner verving de wasrol door een platte plaat met horizontale modulatie in plaats van de verticale modulatie van Edison waardoor vermenigvuldiging met plaatsnijmachines mogelijk werd middels de platenpers. (Figuur 3)

Figuur 3: Berliner vereenvoudigde het vermenigvuldigen van opnamen door een platte schijf als geluidsdrager te gebruiken i.p.v. de cilindrische rollen van de Phonograph.

Overbrengen van geluid

Het bewerken van opnamen was nog steeds erg beperkt, maar daar kwam verandering in, gestimuleerd door andere ontwikkelingen. Want in dezelfde tijd werkte Marconi aan het overbrengen van informatie door middel van radiogolven, bouwend op het werk van Hertz. Aanvankelijk bleef dit beperkt tot morsecode, maar met de toenemende vervoersactiviteit werd radiocommunicatie steeds belangrijker. De hulpvraag van de zinkende Titanic is wereldberoemd geworden doordat andere schepen drenkelingen aan boord konden nemen. Het overbrengen van geluid zelf middels radiogolven werd mogelijk na de uitvinding van de triode door Lee de Forest in 1906, het eerste echte actieve versterkerelement (Wikipedia), zie figuur 4.

Figuur 4: De triode is een van de vacuümbuizen, de eerste actieve versterker component die nog steeds als zodanig wordt gebruikt (Nokia).

Het basisprincipe is het regelen van een grote stroom die van kathode naar anode loopt middels een zwakke spanning op het stuurrooster. Dit ontsloot een compleet nieuwe wereld aan mogelijkheden, waar dan ook al snel enthousiast gebruik van werd gemaakt.

Allereerst natuurlijk het gebruik van radiogolven voor het direct en snel overbrengen van geluid. Deze ontwikkelingen kwamen door de Eerste Wereldoorlog in een stroomversnelling. Maar dit vergt wel zaken als microfoons en luidsprekers, die daarvoor alleen bij telefonie gebruikt werden, maar wel aangepast en verbeterd moesten worden voor audio-gebruik, zie figuur 5.

Voortbordurend op het concept van de triode kwamen andere variaties naar voren, zoals de penthode. Door de koppeling tussen elektriciteit en magnetisme kwam magnetische opslag in beeld, met als bekendste vertegenwoordiger uit die tijd de dictafoon, die staaldraad gebruikte voor de opslag van het geluid (de stem van de bulkende baas die een brief, die de secretaresse moest uittypen, dicteerde) voor een zakenrelatie. Later werd dat opgevolgd door de magnetische band, die nog steeds dienstdoet.

Betere microfoons konden nu worden gebruikt doordat de zwakke signalen versterkt konden worden en, in combinatie met magnetische opslag, werd bewerken mogelijk. Toch bleef voor thuisgebruik de mechanische weergave nog lange tijd populair, de ‘slingergrammofoon’ stond nog in menige kamer (ik heb er ook nog een uit 1928!) en het is verbazingwekkend hoeveel geluid er nog uitkwam! Zelfs een vorm van mechanische volumeregeling werd veelvuldig toegepast (klepjes voor de uitgang van de hoorn) om de overlast voor de buren te beperken. Maar na de Tweede Wereldoorlog werd echter zachtjesaan de mechanische weergave thuis vervangen door de elektronische reproductie vanwege alle, onmiskenbare, voordelen.

De elektronica heeft inmiddels een dominante, centrale plaats in audio ingenomen, van opname, opslag, bewerking tot weergave. En daarvoor zijn de actieve elementen cruciaal, maar zijn ze ook probleemloos? Nou, niet helemaal…..

De transistor

Een belangrijke ontwikkeling was natuurlijk de uitvinding van de transistor (1947 bij de Bell Labs in de VS) getoond in figuur 6.

Deze actieve component heeft een enorme invloed gehad op de ontwikkeling van elektronica omdat deze veel kleiner is dan de vergelijkbare buizen componenten, veel minder kwetsbaar is en een langere levensduur heeft. Ook ontstond de mogelijkheid om meer componenten op een klein plakje silicium te integreren. Dat heeft geleid tot de komst van de IC’s, de geïntegreerde circuits. Dus zijn alle problemen nu opgelost? Was dat maar waar, helaas staan de inherente problemen van actieve componenten na meer dan een eeuw nog steeds recht overeind.

Figuur 5: Het overbrengen van geluid middels radiogolven vergde het aanpassen en verbeteren van microfoons, versterkers en luidsprekers.

Met de komst van de actieve componenten kregen een groot aantal problemen voor audio andere mogelijkheden om deze aan te pakken. Helaas kwam via de achterdeur weer andere narigheid binnen, de bekende ‘Wet van Behoud van Ellende’. De kern van de ellende is de niet-lineariteit van actieve componenten: de relatie tussen in- en uitgangssignaal is geen rechte lijn (zie ook mijn eerdere bijdragen ‘De (on-)zin van Vervormingscijfers’ in Music Emotion 4 en 5) waardoor allerlei artefacten ontstaan, met als bekendste, maar zeker niet de enige, harmonische vervorming, die niet eens de belangrijkste is. In de begintijd maakte men zich daar niet zo druk om, integendeel, omdat actieve componenten erg duur waren, zocht men naar methoden om zoveel mogelijk versterking uit een enkele triode te persen, Daarbij werd meekoppeling niet geschuwd en de hogere vervorming viel onder het hoofdstuk ‘jammer maar helaas’. Pas in de jaren ’30 werd hier beter naar gekeken en het artikel van Black was baanbrekend en een mijlpaal (H.S. Black. Stabilized Feedback Amplifiers, The Bell System Technical Journal, January 1934). Ik zal het belang hiervan absoluut niet willen bagatelliseren, maar uit de discussies die heden-ten-dage (meer dan 90 (!) jaar later) woeden over terugkoppeling is dit toch niet de ultieme oplossing gebleken. Ik heb dit uitgebreid toegelicht in de artikelen hierover die eerder in Music Emotion zijn verschenen en – voor de meer technisch onderlegden – ook naar voren heb gebracht tijdens mijn presentatie voor de Nederlandse Sectie van de Audio Engineering Society (14 mei 2025). In oktober 2025 heb ik deze voordracht gehouden voor de UK sectie van de AES (14 oktober 2025). Van beide zijn de sheets integraal te vinden zijn op de website van ’Temporal Coherence’ (www.temporalcoherence.nl) en kunnen gratis worden gedownload als pdf-file. Het artikel ‘De kloof tussen gemeten en gehoormatige kwaliteit, gerelateerd aan de stiekeme valkuilen van tegen- en terugkoppeling’ geeft diepere achtergrondinformatie over deze problematiek.

Naast deze discussie over terugkoppeling woedt er al jaren een bijna religieuze discussie over het gebruik van buizen of transistoren. Mijn standpunt is dat het onbelangrijk zou moeten zijn of een versterker nu gerealiseerd is met buizen, transistoren, IC’s, FET’s of lege bierblikjes: als het een goede versterker is, zouden de artefacten, die het opwekt, van een dusdanig laag niveau moeten zijn dat het gehoormatig ononderscheidbaar zou moeten zijn waarmee deze is gebouwd. Maar helaas weten we, bijna 150 (!) jaar nadat Edison de eerste stappen op het gebied van geluidsweergave heeft gezet, nog steeds niet wat we moeten meten om een goede voorspelling te krijgen voor de gehoormatige kwaliteit. Eigenlijk is dit te zot voor woorden en ik vind het onbegrijpelijk dat we nog steeds op dit punt staan. Onderzoek had toch al lang duidelijk moeten maken waar de schoen wringt? Maar door dit gebrek aan inzicht is er ook geen goede sturing mogelijk voor het – gehoormatig – verbeteren van audioapparatuur, het heeft nog steeds veel weg van geblinddoekt pijltjes gooien en hopen dat je de roos raakt. Veel ontwerpers pogen juist om de – gemeten – specificaties te verbeteren, maar vragen zich daarbij onvoldoende af of dit gehoormatig wel goed uitpakt. Zo is inmiddels gebleken dat met zware terugkoppeling weliswaar prachtige specificaties kunnen worden bereikt, maar vaak klinkt het dan niet ‘muzikaal’. Als ik zelf sommige apparaten beluister, vraag ik me wel eens af of de ontwerpers wel oren aan hun hoofd hebben en/of wel eens naar een live concert gaan (en dan wel eentje zonder elektronica, zoals bijvoorbeeld in het Concertgebouw worden gegeven). Op zich verbaast me het dan ook niet dat op shows amper klassieke muziek te beluisteren valt (zelfs niet die met een kleine bezetting zoals een pianotrio of strijkkwartet) want er zijn er maar enkele systemen die hiervan een te pruimen resultaat neerzetten. En dat zou toch het streven moeten zijn van ontwikkelaars en ontwerpers? Het feit dat veel van de gehoormatige verbeteringen van kleine bedrijven komen, geeft natuurlijk ook al te denken.

Dogma's

Als we verdere verbeteringen willen van de gehoormatige kwaliteit (en dat is zeker mijn doel!) dan zullen we een aantal dogma’s in audio overboord moeten zetten. Als eerste zal de negatieve houding over luistertesten in de versnipperaar moeten verdwijnen. Want ons is gebleken dat ons gehoor nog steeds het beste ‘meetinstrument’ is dat we hebben, zeker als het aankomt op het weergeven van muziek. Het tweede dogma dat er zo snel mogelijk achteraan moet is dat als de frequentiekarakteristiek maar ‘recht’ is van 20 Hz tot 20 kHz, het ‘goed’ is. Als dat zo zou zijn, kunnen de gehoormatige verschillen tussen veel luidsprekers niet begrepen worden. Niet alleen vereist het temporeel oplossend vermogen van het menselijk gehoor een veel ruimere bandbreedte, het tijdgedrag van veel luidsprekers verknoeit veel. Zie ook ‘De (on-)zin van Basreflex behuizingen’ in Music Emotion 10 van oktober 2025.

Het derde dogma dat eraan moet geloven is dat de harmonische vervormingscijfers zaligmakend zijn. Andere artefacten, waarvan de nodige niet eens gemeten worden, zijn gehoormatig veel belangrijker, daarnaast zijn deze cijfers veel te grof. Leg maar eens een aantal specificaties naast elkaar en ga dan eens luisteren: veel buizenversterkers hebben significant slechtere specificaties dan halfgeleiderversterkers, maar klinken vaak wel beter. En een luidspreker met 0,01% vervorming moet nog uitgevonden worden. En zo zijn er nog wel meer voorbeelden te vinden.

Het zal nodig zijn om een veel uitgebreidere theorie te ontwikkelen voor de gedragingen van teruggekoppelde systemen met complexe signalen als muziek, omdat de nu gangbare theorie op dit punt ernstig tekortschiet. Ook zal het essentieel blijken om testsignalen te ontwikkelen die veel meer gelijkenis vertonen met muziek om een beter vergelijk met de gehoormatige bevindingen te bewerkstelligen. Maar zolang deze er niet zijn, is luisteren met muziek toch nog steeds de beste manier om de gehoormatige prestatie van een audiosysteem te beoordelen. Behalve natuurlijk voor hen, die op de bank lekker naar een testtoon gaan zitten luisteren…

Hans R.E. van Maanen

Temporal Coherence, www.temporalcoherence.nl

Reacties (0)